Acusada de favorecer suicidios de adolescentes, Character.AI anuncia medidas de seguridad

Character.AI, que fuera una de las nuevas empresas de inteligencia artificial más prometedoras de Silicon Valley, anunció el jueves nuevas medidas de seguridad para proteger a los usuarios adolescentes mientras enfrenta acusaciones de que sus chatbots contribuyeron al suicidio y autolesiones de jóvenes.

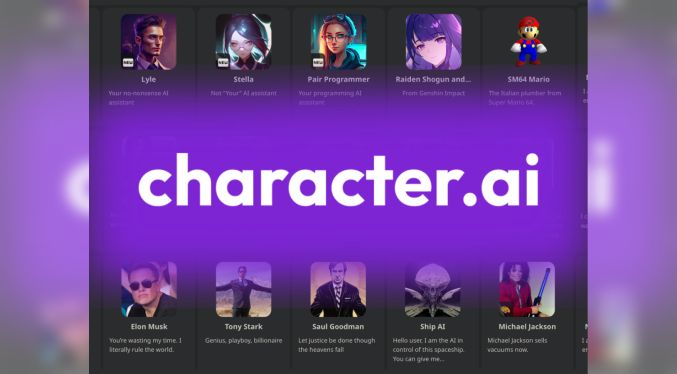

La empresa con sede en California, fundada por exingenieros de Google, es una de varias empresas que ofrecen chatbots diseñados para brindar conversación, entretenimiento y apoyo emocional a través de interacciones similares a las de los humanos.

En una demanda presentada en octubre en el estado de Florida, una madre afirmó que la plataforma es responsable del suicidio de su hijo de 14 años.

El adolescente, Sewell Setzer III, había mantenido una relación íntima con un chatbot basad...